En la última década ha habido una revolución en el campo de Inteligencia Artificial (IA) que ha hecho posible transferir productos de investigación y desarrollos tecnológicos a diferentes campos de aplicación como el reconocimiento facial, la traducción automática y el reconocimiento de voz [1]–[3]. En particular, la digitalización de las comunicaciones y la expansión del acceso al internet han puesto estos avances literalmente en la palma de nuestras manos a través de los dispositivos móviles. Por ejemplo, hoy en día es muy común usar traductores automáticos en nuestro celular y con ellos descifrar mensajes en idiomas diferentes al nuestro. Hasta la década pasada, la IA y los métodos asociados a esta tecnología eran desarrollados de manera incremental en múltiples laboratorios en universidades alrededor del mundo. Con el advenimiento de las técnicas basadas en redes neuronales (también denominadas deep learning) los ciclos de investigación, desarrollo, producción y adopción han disminuido en duración y aumentado en frecuencia [4]. Por ejemplo, tomó a Google Translate un año portar las metodologías de redes neuronales que estaban siendo investigadas en 2015 para ponerlas a disposición de sus usuarios a mediados de 2016. Aunque esto en teoría supone buenas noticias para los ciudadanos digitales, la prontitud con que se hacen las investigaciones, conjugado con el alcance multitudinario que tienen estas tecnologías, apuntan a que necesitamos mecanismos formales basados en preceptos éticos para regular y mitigar los impactos negativos que los sistemas basados en IA tienen en nuestra sociedad.

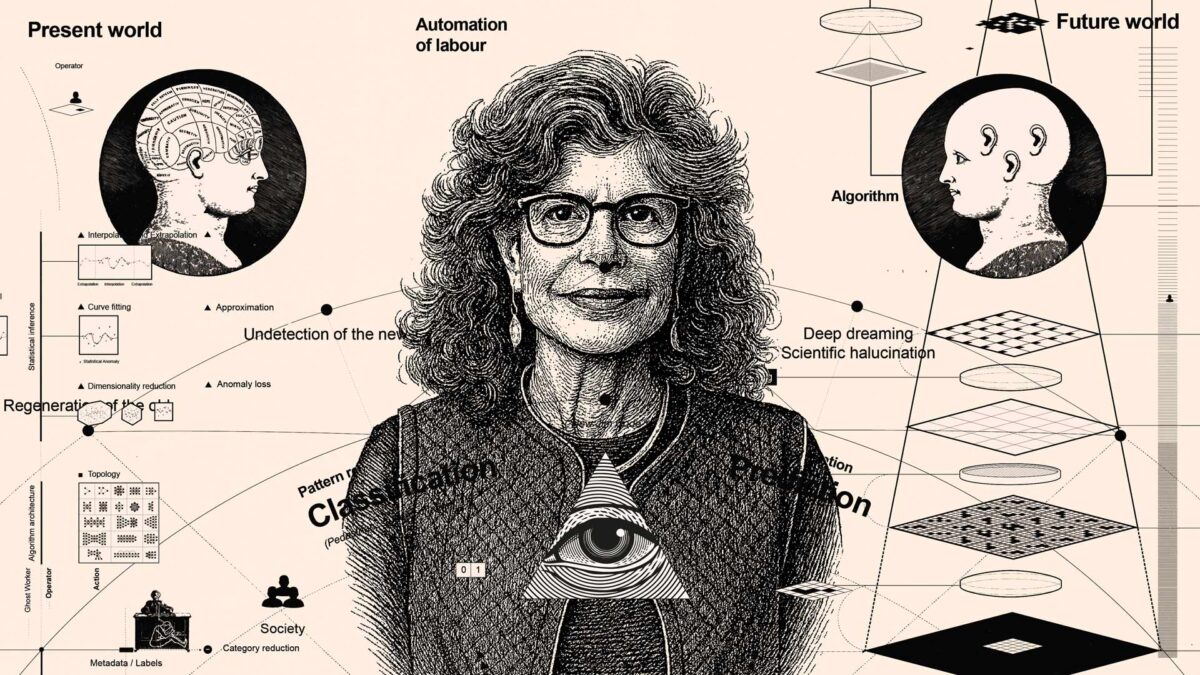

Sistemas basados en Inteligencia Artificial

Los sistemas basados en IA son sistemas computacionales, como lo son las hojas de cálculo, los editores de texto, las bases de datos, los sistemas de nóminas o las páginas de internet. Este tipo de sistemas, al igual que los ejemplos pasados, son ejecutados por computadoras y tienen una utilidad específica. A diferencia de otros sistemas computacionales, uno basado en IA tiene como fin la toma de decisiones y además, se espera que la decisión tomada tenga un efecto en el mundo real en diferentes niveles. Por ejemplo, existen sistemas de IA que deciden comprar o vender acciones en el mercado de valores [5]. En este caso la decisión a la que llega el sistema de IA se espera tenga un efecto directo, promoviendo o descartando la compra de acciones, en algunas ocasiones miles de veces por segundo. En otros sistemas de IA, la decisión tomada es para el consumo de las usuarias; por ejemplo, existen sistemas de IA que emiten recomendaciones de productos, lecturas, películas, noticias, etc. [6]. Finalmente, existen sistemas de IA que toman decisiones a bajo nivel como parte del proceso para producir una salida que será consumida por otro sistema. El reconocimiento de voz automático es un ejemplo de este tipo de sistema. Las decisiones tomadas por en sistema de reconocimiento automático de voz producen una transcripción del audio. Posteriormente esta transcripción puede ser utilizada como entrada por otro sistema, como para realizar una búsqueda en internet [7].

Es deseable tener sistemas que tomen decisiones por nosotros dado su potencial de facilitarnos aspectos de nuestra vida cotidiana. Sin embargo, no hay que confundirlos con meras herramientas. Al caracterizarlos como herramientas negamos su propiedad más definitoria que es su capacidad de actuar en el mundo, es decir, son sistemas con un nivel de agencia. En este sentido, los sistemas basados en inteligencia artificial toman decisiones en situaciones “reales”. Es cuando este ciclo se cierra que los sistemas son de mayor beneficio para nosotros. Por ejemplo, los sistema de IA que detecta si un correo electrónico es de spam o no, son útiles hasta que son aplicados a los correos que llegan a nuestra bandeja; el efecto es tener orden en nuestros correos y por ende en nuestras vidas digitales. Sin embargo, es precisamente la agencia de sistemas de IA que resalta la importancia de analizar los impactos derivados del uso masivo de estos sistemas.

Recientes avances en la Inteligencia Artificial

La razón principal del avance en el campo de la IA en la última década se debe a la adopción y explotación de los sistemas de redes neuronales, ahora llamados de aprendizaje profundo [8]. Esta adopción ha sido motivada por un cambio fundamental en el pensamiento de cómo construir sistemas inteligentes y de la promesa de una mejora económica para los individuos u organizaciones que desarrollen este tipo de sistemas. En particular, en la última década, el campo de la IA se ha enfocado en la construcción de sistemas que imitan comportamientos inteligentes en lugar de crear sistemas que posean conocimiento y estrategias que guíen el comportamiento inteligente. Esta preferencia por sistemas imitadores de inteligencia ha sido gradual y se sustenta en tres factores fundamentales:

La consolidación del campo de aprendizaje de máquina: el aprendizaje de máquina es un campo de estudio de modelos que capturan comportamientos codificados en ejemplos de dicho comportamiento. Por ejemplo, para decidir si un correo es spam o no, se necesitan cientos o miles de correos con la especificación de ser o no spam. Los métodos de aprendizaje máquina usan las especificaciones dadas para encontrar patrones que diferencian los correos spam de los no spam. En particular, el aprendizaje profundo es un tipo de aprendizaje de máquina.

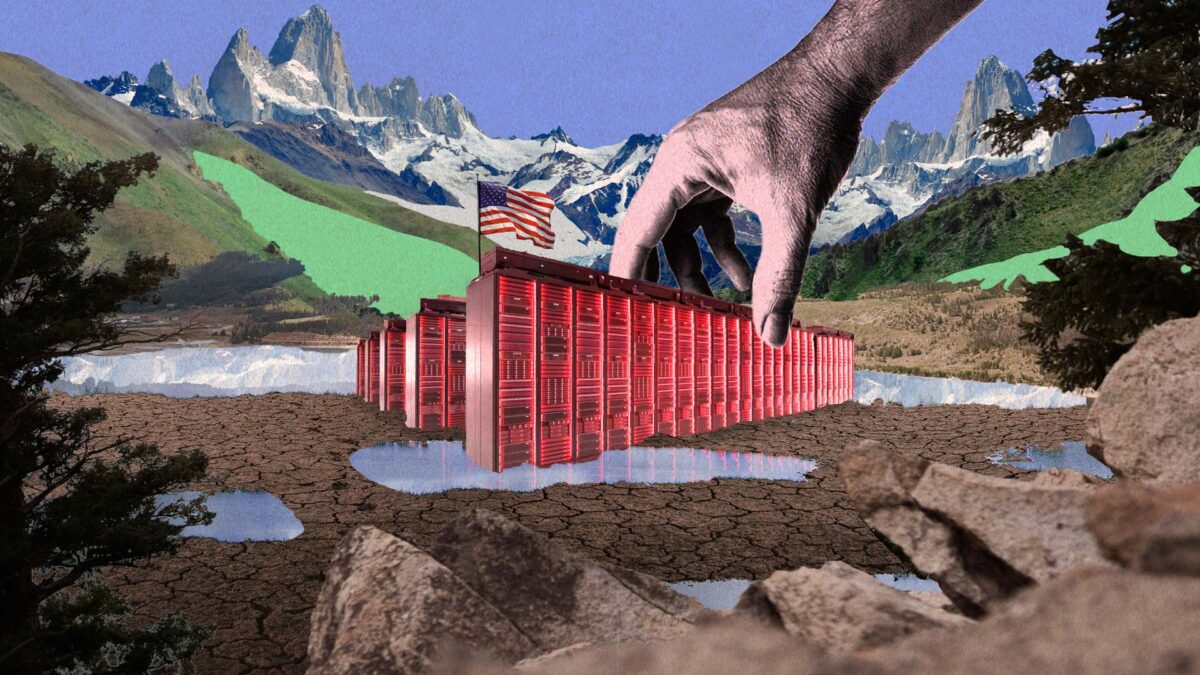

La disponibilidad masiva de datos: el uso de metodologías de aprendizaje profundo para crear sistemas inteligentes que imiten comportamientos específicos, requiere necesariamente ejemplos de dichos comportamientos. Por lo tanto, la consolidación del aprendizaje automático está relacionada con la recolección y el almacenamiento de datos en forma masiva, motivada por la expansión del internet, avances en los campos de big data y de las telecomunicaciones.

El incremento de la capacidad de cómputo: el procesamiento de cantidades masivas de datos utilizado por las técnicas de aprendizaje automático requiere una capacidad de cómputo considerable. Afortunadamente el poder de cómputo ha crecido siguiendo La ley de Moore [9]. Además en los últimos años ha surgido equipo específico de hardware que apoya la aceleración de los métodos de aprendizaje profundo.

Estos tres factores han permitido una revolución en el campo de la IA. En este sentido, organizaciones que tienen acceso al equipo de cómputo adecuado, que dominan la técnica de aprendizaje profundo y poseen los datos adecuados están en la posición de crear sistemas que imitan la inteligencia: traductores, reconocedores de voz, traders automáticos, etc. Se ha preferido el enfoque del aprendizaje de máquina sobre la creación de sistemas con otros tipos de inteligencia ya que para muchos comportamientos inteligentes no se cuenta con una teoría o con los conocimientos necesarios. Ante dicha incertidumbre, la creación de sistemas inteligentes usando la metodología del aprendizaje automático ha permitido llevar a usuarias finales estas capacidades.

Es importante recalcar que, los factores que han motivado el desarrollo del campo también han significado retos dentro del mismo. Un reto es económico. Tener acceso al equipo de cómputo ideal para desarrollar buenos sistemas de IA es fundamental, sin embargo esto no es posible para todos, ya que los equipos no son accesibles. Otro reto tiene que ver con el dominio de la técnica. Los grupos de investigación y organizaciones que fueron rápidos en adoptar y dominar las técnicas hoy conforman centros de vanguardia en el campo, para el resto, hoy en día es una carrera de actualización continua. Finalmente, otro reto es la adquisición de datos. De hecho, este es el reto más estratégico ya que como veremos no es sólo el hecho de contar con los datos, sino las propiedades intrínsecas de éstos las que determinan el tipo de sistema a crear. Hoy en día una gran cantidad de las deficiencias de los sistemas inteligentes recaen en que no tienen acceso a los datos adecuados o a que simplemente no se identificó a los datos como elemento esencial.

Problemas con la naturaleza de datos

Dado que las metodologías dominantes para crear sistemas de IA requieren datos que contengan el comportamiento a imitar por los sistemas, conseguir esos datos es esencial para el desarrollo de estos sistemas. La recolección, limpieza y preprocesamiento de los datos que alimentan a los sistemas inteligentes son una de las tareas que consumen más tiempo y dinero en la etapa de desarrollo. Es interesante que conceptos tan establecidos como “garbage in garbage out” (basura entra basura sale) tienen un efecto palpable en el campo de sistemas inteligentes. Si no cuidamos la recolección, la limpieza y el preprocesamiento de los datos, nuestro sistema tomará decisiones sin sentido, poco útiles y no benéficas para nosotros. Adicional a esta complejidad técnica se presenta un problema más sutil que son los sesgos presentes en los datos que son replicados por los sistemas inteligentes [10]. Estos sesgos muchas veces no tienen que ver con la calidad de los datos sino con estructuras sociales que permean los datos.

Uno de los casos más conocidos son los sesgos en el nivel de desempeño de los sistemas de reconocimiento de rostros. Los sistemas automáticos de reconocimiento de rostros tienen el objetivo de identificar de forma automática propiedades sobre un rostro que observan, algunas de esas propiedades podrían ser edad o género. En su trabajo las investigadoras Buolamwini y Gebru identificaron un sesgo persistente en sistemas de reconocimiento de rostros diseñados para clasificar el género de un rostro (de forma binaria mujer/hombre): Sus investigaciones mostraron que mientras el género de los hombres con piel blanca es identificado casi al 100%, el género de mujeres con piel negra es clasificado de forma correcta entre un 65% y 80% [11]. Dado el tipo de sistema (reconocimiento de rostros) esta disparidad en las predicciones sólo puede tener origen en los datos con los que se entrenaron los sistemas. En otras palabras, en los datos de entrenamiento (datos utilizados por el sistema como la realidad a emular) debió existir una subrepresentación de mujeres de piel negra. Esto lo sabemos ya que los sistemas de IA son mejores haciendo predicciones sobre datos que han “viso” en los datos de entrenamiento, en este caso hombres de piel blanca. Por otro lado, los errores en las predicciones (en este caso la asignación incorrecta del género) de este tipo de sistemas ocurren con mayor frecuencia en datos que el sistema no ha “visto” frecuentemente en los datos de entrenamiento, en este caso las mujeres de piel negra.

Combatir los sesgos de género se ha convertido en una prioridad del campo de la IA. Sin embargo, ya que los sesgos de género están embebidos en los comportamientos sociales, los esfuerzos por corregir estas problemáticas en sistemas de IA han sido fútiles. Por ejemplo, una compañía internacional de tecnología tomó la decisión de parar el desarrollo de un sistema de IA para la evaluación de candidatos a puestos laborales debido a la imposibilidad de remover sesgos de género. En particular, para crear este sistema de IA se buscaba aprovechar toda la información disponible en la base de datos de contrataciones y trayectorias laborales dentro de la compañía. Al analizar las primeras versiones del sistema de IA se descubrió que este favorecería el tipo de lenguaje utilizado por hombres, dándoles mejores calificaciones que a las mujeres al analizar sus curriculums. En este caso, el sesgo estaba relacionado con los patrones sociales codificados en los datos utilizados para entrenar el sistema. La compañía históricamente había contratando a muchos más hombres que a mujeres. Como el sistema fue diseñado utilizando los datos históricos de la compañía, este “aprendió” a replicar los patrones históricos de contratación, que reflejaban un claro favoritismo hacia los hombres.

Como vemos, por un lado las relaciones intrínsecas de los datos reflejan muy bien estructuras no explícitas de la sociedad, como lo es la discriminación. Por otro lado, la principal técnica utilizada para crear IA está basada en imitar comportamientos en los datos, lo que provoca que los sistemas de IA “aprendan” y reproduzcan prácticas discriminatorias.

Problemas con las fuentes de datos

Es evidente que los datos son esenciales para el desarrollo tecnológico de sistemas inteligentes. Aunque hay una gran disponibilidad de datos actualmente, no todas las grandes colecciones de datos (bases de datos) son igualmente útiles. En particular, las colecciones que sobresalen son aquellas en donde las entradas están etiquetadas con su salida correspondiente. Por ejemplo, en el caso de sistemas reconocimiento de mascotas que clasifica imágenes por especie, una entrada correspondería con una imagen de una mascota, una etiqueta con las especies de la mascota (e.g. gato/perro/tortuga/hamster etc.). La salida del sistema es la predicción esperada por el sistema, en nuestro ejemplo la salida corresponde con la especie de mascota. Por lo tanto una colección etiquetada para entrenar este modelo correspondería con un conjunto de imágenes de mascotas cada una con la etiqueta que indique su especie.

Las bases de datos etiquetadas son de mucho valor, ya que las técnicas de IA son particularmente buenas en este esquema, llamado aprendizaje supervisado. Bajo el aprendizaje supervisado es posible crear sistemas de IA que imiten el comportamiento codificado en la entrada-salida (datos-etiquetas). Aunque existen otros esquemas donde no se necesita etiquetar la salida (como el aprendizaje por refuerzo [12] o el aprendizaje auto-supervisado [13]) en el último lustro los sistemas de aprendizaje supervisado son los que han permitido una nueva generación de sistemas traductores, de reconocimiento de voz, de reconocimiento de rostros, etc.

Algunas preguntas relevantes en torno al esquema de aprendizaje supervisado son: ¿de dónde salen estas colecciones? ¿qué procedimientos se siguieron para su recolección? ¿qué garantías proporcionan estas colecciones? Para responder estas preguntas tenemos que entender que el valor asociado a estas colecciones viene de dos factores principales. Primero de la secrecía de los datos, que es utilizada estratégicamente para aumentar el valor del sistema inteligente que imita el comportamiento codificado en esa información.

Segundo, la apertura de una colección también le da valor, ya que al poder ser utilizada por muchos grupos de desarrollo permite ir aumentando la capacidad de imitación de los sistemas. Ante esta dicotomía hay colecciones de datos que son valiosas porque son secretas y hay colecciones que son valiosas porque son abiertas. Por lo general, las colecciones abiertas surgen de la comunidad científica que las hace disponibles para avanzar el campo. Estas colecciones tienden a seguir procedimientos para que las colecciones sean representativas de una población en un contexto específico bajo criterios (muchas veces cuestionables) de representatividad. Como vimos en la sección anterior, el que una base de datos sea representativa (como datos históricos de contrataciones de una compañía) no garantiza que no tenga sesgos.

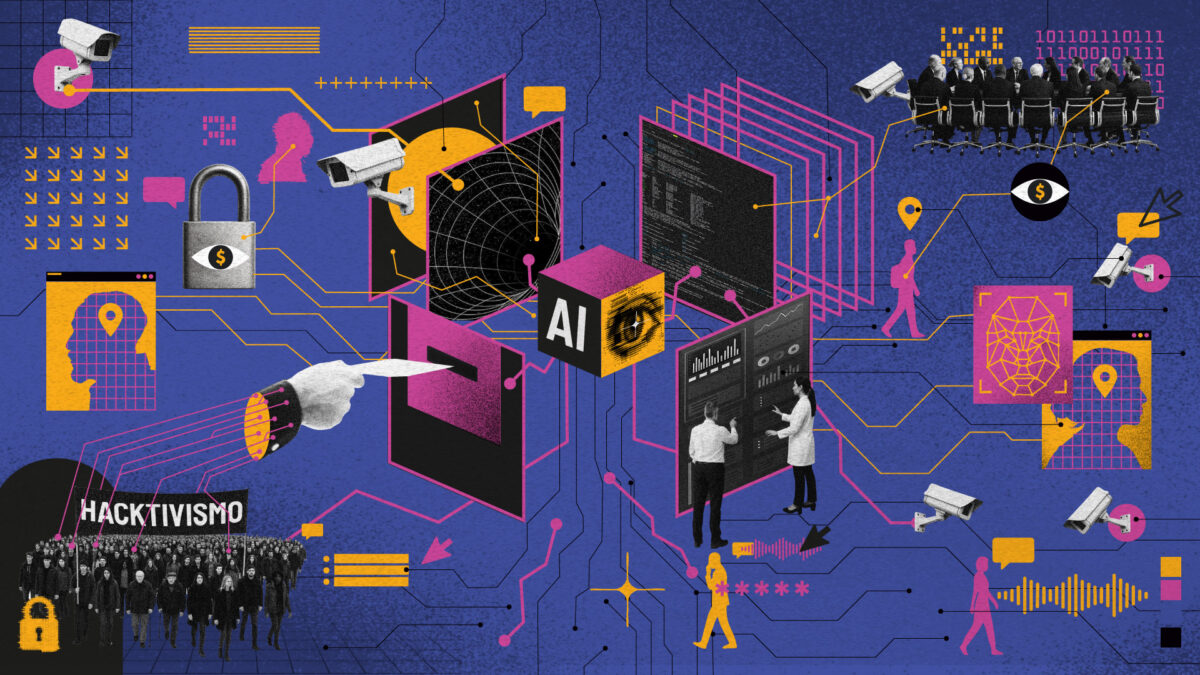

Igualmente preocupante a los sesgos presentes en los datos es que en el afán de recolectar las colecciones de datos, donde preceptos éticos no son tomados en cuenta. En los últimos años ha salido a la luz que un gran número de bases de datos se recolectaron sin consentimiento de las personas, tomando en cuenta legislaciones o contextos legales laxos. La comunidad de visión computacional, encargada de hacer sistemas inteligentes con aplicaciones como la identificación de personas, el reconocimiento de éstas y su monitoreo, ha estado plagado de estas problemáticas. La investigación MegaPixels, comandada por Harvey y LaPlace, expone algunos de estos errores, visualiza el impacto del uso estas colecciones e invita a la reflexión sobre éstas [14]. Hasta ahora tres colecciones masivas de imágenes han retirado su acceso público. Este año la organización detrás de ImageNet, una de las colecciones de imágenes más amplias, ha estado trabajando en arreglar aspectos de justicia y representatividad en la colección [15]

En el caso de las colecciones de datos secretas es más difícil tener acceso e identificar omisiones éticas dada su naturaleza privada. Sin embargo, algunos casos han sido puestos a la luz. Recientemente se dió a conocer que una empresa desarrolló una aplicación móvil para guardar y organizar fotos personales en la nube usó las fotos de sus usuarias para entrenar una herramienta de reconocimiento de rostros. Esa herramienta forma parte de otro producto que ofrece la misma compañía con el propósito de monitoreo. El argumento utilizado por la compañía para justificar estas acciones fue que los términos de uso de la primera aplicación lo permitían. Otro de los casos más notables sobre la extracción de información sin consentimiento fue a través de la plataforma Facebook que permitió a terceros recolectar una cantidad gigantesca de información que luego fue usada con fines electorales [16]. México no quedó exento de estas problemáticas de recolección masiva de datos.

Problemas en el propósito de los sistemas

La metodología de creación de sistemas inteligentes basados en técnicas de aprendizaje de máquina no impone ninguna restricción en qué es la entrada y qué es la salida esperada. Uno puede poner cualquier lenguaje como entrada y como salida cualquier otro, y con suficientes ejemplos y un poco de adaptación el sistema podrá aprender a traducir de una lengua a otra. Igualmente, uno puede destinar este mecanismo a cualquier tarea. La tentación de poner cualquier elemento es muy alta, recientemente investigadores usaron fotografías de presos contra fotografías de personas en redes sociales para determinar factores criminalísticos en los rostros, por supuesto, estas ideas se encontraron con múltiples críticas éticas. Otros casos la falta de crítica han terminado en investigaciones publicadas en temas como: auto-generar comentarios en redes sociales [17] y decidir el veredicto de juicios con base a hechos del expediente [18].

Para sistemas comerciales el campo de del IA abre un abanico de posibilidades, en particular estamos ante la oportunidad de modelar cualquier comportamiento. En particular, los desolladores de sistemas comerciales están interesados en replicar aquellos comportamientos que no sólo les dan una ventaja competitiva sino que hacen que sus usuarias no abandonen las plataformas. Por ejemplo, no es secreto que empresas buscan mejores recomendaciones ya que la usuaria disfrutará el servicio y permanecerá más tiempo en la plataforma. Hoy en día se investigan mecanismos de aprendizaje automático que repercuten en tiempo viendo contenido en las plataformas [19]. Sin embargo, si la plataforma siempre es capaz de proporcionar contenido interesante a la usuaria, para ésta es muy difícil abandonar la plataforma. Actualmente, se habla de mecanismos de adicción asociados a los comportamientos de consumo de estos servicios [20].

Inteligencia Artificial y Derechos Humanos

Los problemas sociales asociados con las inteligencias artificiales actuales tienen dos fuentes principales: los datos y el diseño. Como vimos anteriormente, los datos utilizados durante la creación de sistemas autónomos son considerados por los mismos como “la realidad”. Esto quiere decir que, de haber sesgos en los datos, éstos pueden ser repetidos y amplificados por el sistema, lo cual está teniendo como consecuencia la sistematización de problemáticas sociales como el racismo y la discriminación de género [21]. Esto evidencia que los sistemas autónomos atentan contra los derechos de igualdad y no discriminación. En cuanto al diseño, la mayoría de sistemas inteligentes tienen como objetivo optimizar una función específica. Esto se convierte en un problema cuando el objetivo para el cual fue diseñado un sistema no es considerado benéfico para la sociedad. Para entender mejor esta problemática pensemos en una IA encargada de decidir qué contenido es mostrado a los usuarios en las redes sociales. En otras palabras, el sistema tiene como objetivo la moderación de contenido. Uno de los diseños más utilizados para este tipo de sistemas es el de optimizar el número de reacciones [22]. Esto quiere decir que el sistema da prioridad al contenido que ha sido comentado o compartido muchas veces. Ahora bien, gran parte del contenido viral en internet tiende a ser polémico, extremista y a generar un discurso de odio. De este modo, crear sistemas autónomos con la función de optimizar clics da prioridad a cierto tipo de discursos sobre otros [23]. Lo que nos obliga a hacer una seria reflexión sobre la influencia que la IA tiene sobre la libertad de expresión y la libre autodeterminación de las personas. Estas problemáticas son sólo algunos ejemplos del por qué necesitamos establecer, de manera urgente, normativas y principios de buenas prácticas en el área de del IA que permitan garantizar la protección de los derechos humanos.

Propuesta para la creación de Comisiones y Comités de Ética en Inteligencia Artificial

La creación de estatutos y organismos especializadas en la regulación y el arbitraje en el campo de la IA a nivel nacional e internacional será un proceso complejo, el cual requerirá la colaboración del gobierno, la industria, la academia y la sociedad civil. Sin embargo, tomando en consideración que gran parte de las técnicas y los avances en el área son llevados a cabo en universidades, es esencial que dichas instituciones comiencen a regular los sistemas inteligentes creados dentro de sus instalaciones. Para ello, proponemos que cada universidad nacional, donde se desarrolle IA, integre una comisión y un comité de ética, ambos especializados en las problemáticas asociadas al desarrollo de dicha tecnología. Consideramos que la función primordial de las Comisiones de Ética en Inteligencia Artificial debe ser la de definir los principios de buenas prácticas para el desarrollo de sistemas inteligentes dentro de cada institución. De manera ideal, las Comisiones de Ética en Inteligencia Artificial de las universidades estarán en comunicación y colaboración constante, para homogeneizar la regulación del campo a nivel nacional. Por otro lado, sugerimos que el rol de los Comités de Ética en Inteligencia Artificial sea el de vigilar el cumplimiento de los principios éticos establecidos en la institución correspondiente, a través de la evaluación y el seguimiento de proyectos relacionados con IA.

Debido a las capacidades y la amplia variedad de aplicaciones de sistemas autónomos, creemos esencial que las comisiones y comités de ética en IA sean integradas por especialistas en distintas áreas del conocimiento. En particular, es fundamental crear vínculos estrechos entre los organismos que regulen la IA y los comités de bioética existentes a nivel nacional. De hecho, creemos que establecer el nexo entre la bioética y la ética en inteligencia artificial es el paso central del proceso de estandarización de buenas prácticas en el área. Sin embargo, es importante recalcar que existen diferencias significativas entre las problemáticas dentro del ámbito de la bioética, y las relacionadas con la IA. Para entender la relación entre estas dos áreas, y cómo es que la bioética juega un papel central en nuestra propuesta debemos discutir el tema de la bioética más a fondo.

La bioética como referente

La velocidad vertiginosa con la que progresan la ciencia y la tecnología genera un constante desfasamiento entre el uso de ciertas técnicas y su regulación. Un claro ejemplo de esto se puede apreciar en el campo de la biotecnología. Esta área, dedicada al uso de seres vivos y organismos para la creación de productos ha existido desde tiempos inmemoriales. La selección artificial de plantas que produjo la agricultura, la fermentación y la producción de vacunas son ejemplos de avances en el campo. En décadas más recientes, la biotecnología ha desarrollado procedimientos para la edición de ADN y la síntesis de proteínas. La capacidad de manipular los bloques fundamentales de la vida expandió nuestros horizontes, dándonos la posibilidad de recuperar especies extintas o de crear nuevos medicamentos. Sin embargo, también amplificó la capacidad humana de producir impactos negativos en el planeta. Por ejemplo, modificar genéticamente a los mosquitos para erradicar enfermedades como la malaria podría tener efectos catastróficos en el medio ambiente [24]. Este tipo de problemáticas, de igual modo las derivadas de la biología y de las ciencias de la salud, han llevado a la creación de normativas y principios de buenas prácticas que tienen como eje central a la bioética. Esta disciplina se encarga de ampliar las consideraciones morales, tradicionalmente asociadas a los humanos, a los demás seres vivos. En otras palabras, la bioética tiene como interés central el bienestar no sólo de la especie humana, sino de todos los organismos que habitan en el planeta. Actualmente, existen organismos nacionales (e.g. CONBIOÉTICA en México) e internacionales (e.g. UNESCO) enfocados en el desarrollo e implementación de la bioética, asimismo, las universidades cuentan con comités de bioética que regulan las actividades clínicas y académicas.

Para dar un ejemplo de las normativas bioéticas existentes a nivel universitario, tomaremos como referente a la Universidad Nacional Autónoma de México (UNAM). Usando como fuente el acuerdo publicado en agosto del 2019 donde es establecen los lineamientos para la integración y conformación de comités de ética en la universidad. Este documento define las responsabilidades de los comités de bioética de la siguiente manera:

Comité de Bioética: se encarga de abordar sistemáticamente y de forma continua la dimensión ética de a) las ciencias médicas y de la salud, b) las ciencias biológicas y c) las políticas de salud.

En particular, los lineamientos referentes a investigaciones y prácticas donde participan seres humanos establecen que dichas actividades deben responder a los siguientes principios éticos.

Principio de autonomía: implica el reconocimiento de la capacidad del sujeto de la investigación para la toma de decisiones que se plasma en el consentimiento informado.

Principio de no maleficencia: se entiende como la responsabilidad del personal académico o alumnado de minimizar los daños y riesgos reales o potenciales de quienes participan como sujetos de investigación.

Principio de beneficencia: implica maximizar los beneficios para los sujetos participantes en la investigación, además de garantizar que el riesgo de las investigaciones sólo puede tomarse cuando no exista una alternativa.

Creemos que los principios éticos de autonomía, no maleficencia y beneficencia, centrales para la bioética, deben ser adoptados dentro del campo de la IA. En particular, es fundamental que las investigaciones y los proyectos de IA cuenten con el consenso informado de los individuos de quienes fueron recolectados los datos. Normativa que hasta ahora no existe en la mayoría de los campos de la ciencia de datos.

Recomendaciones

Existen sistemas de IA que entran dentro de las regulaciones de la bioética, como los que utilizan datos de voz. Sin embargo, la ética de la IA debe atender problemas sociales, como la discriminación y la libertad de expresión, dando prioridad al respeto de los derechos humanos. Por ello, consideramos fundamental que se reflexione y trabaje para crear una ética de la IA , nutrida de la bioética, pero enfocada al estudio de las problemáticas derivadas del procesamiento masivo de datos y de la agencia de sistemas autónomos inteligentes. Crucial para esto será la consolidación de las comisiones y los comités de ética universitarios.

A continuación hacemos un análisis de la legislación universitaria de la UNAM, que consideramos relevante para la creación de Comités de Ética de la Inteligencia Artificial en las universidades nacionales. En particular, utilizaremos como referente el acuerdo publicado en la Gaceta UNAM en agosto del 2019 que establece los lineamientos para la conformación y registro de comités de ética en la Universidad Nacional Autónoma de México. Documento donde se establece que los Comités de Ética deben ser órganos especializados con el compromiso de vigilar las prácticas académicas y científicas garantizando el respeto y la protección de los sujetos de investigación, procurando que se actúe de acuerdo a las buenas prácticas, y que atiendan las cuestiones éticas de su respectiva dependencia universitaria. Dentro de esta definición se propone hacer una distinción de Comités de Ética de acuerdo con las tareas específicas que sean llevadas a cabo por el organismo. Existiendo comités con las funciones: consultiva, de dictamen de seguimiento y educativa. En particular, de acuerdo con nuestra propuesta, los Comités de Ética en Inteligencia Artificial deberían tener la función de dictamen, ya que dentro de los lineamientos universitarios los comités con la función de dictamen son los encargados de analizar, revisar y dictaminar desde la perspectiva ética los protocolos de investigación de disciplinas donde se incluya la participación de seres humanos. Por otro lado, cabe destacar que dentro de los acuerdos para la creación de comités de ética de la UNAM no requiere la creación de normativas y de principios de buenas prácticas como una de las funciones a ser desempeñadas por los Comités de Ética. Es por ello que hemos propuesto la creación de un organismo distinto encargado de desempeñar dicha función: las Comisiones de Ética en Inteligencia Artificial. Cabe destacar, que la universidad requiere que los Comités de Ética redacten una Guía de Funcionamiento Interno, sin embargo este documento hace referencia a la parte operacional del comité, más que atender a los cuestionamientos éticos de su área de especialización.

Continuando con el análisis del acuerdo universitario existen distintos tipos de comités, clasificados de acuerdo al tipo de problemáticas a abordar. Por ejemplo, existen comités de Bioética, de Bioseguridad, de Integridad Académica y Científica, entre otros. En particular, nosotros sugerimos que el Comité de Ética en Inteligencia Artificial sea considerado como un Comité de Ética de la Investigación, definido como:

Comité de Ética de la Investigación: Es un tipo de comité que se conforma en las coordinaciones, entidades académicas y dependencias universitarias en donde se llevan a cabo actividades de investigación o docencia en seres humanos, los cuales participan como sujetos de investigación, en el marco de las disciplinas de las ciencias exactas, naturales, biológicas, humanidades y sociales, con el objetivo de salvaguardar sus derechos.

Creemos que este tipo de comité ético es el más adecuado para representar el campo de la IA ya que consideramos que gran parte de los sistemas autónomos actuales caen dentro de la definición de investigación en seres humanos. La cual está definida de la siguiente manera:

Investigación en y/o con seres humanos: involucra la recopilación o análisis sistemático de información sobre seres humanos, con el propósito de generar nuevos conocimientos en la que los sujetos de investigación son expuestos a la manipulación, intervención, observación u otra interacción con personal académico, ya sea de manera directa o a través de la alteración de su entorno.

Sabemos que existen sistemas autónomos inteligentes que recopilan y analizan información de las usuarias de manera constante. En particular, los motores de búsqueda, los sistemas de recomendación de películas y los traductores en línea son ejemplos de ello. Además de analizar información, estos sistemas toman decisiones y actúan en el mundo, muchos de ellos en tiempo real. Por ejemplo, los sistemas de IA que moderan el contenido de las redes sociales tomando en consideración las reacciones de las usuarias (me gusta, comentarios etc.), seleccionan que será presentado a cada usuaria dependiendo de la actividad en la plataforma. Esto quiere decir que existen sistemas de IA que usan los datos obtenidos de humanos para alterar su entorno. Por este motivo consideramos que existen varios sistemas de IA que deberían ser clasificados como investigación en seres humanos. Las normativas asociadas a este tipo de procedimiento deben ser respetadas para el desarrollo de sistemas de IA. En particular, se deberían respetar los principios éticos de autonomía, no maleficencia y beneficencia. Lo cual incluye la obligación de contar con un consentimiento informado por parte de los individuos cuyos datos son utilizados para la creación de sistemas inteligentes. Por otro lado, el principio de no maleficencia debería garantizar que los sistemas de IA sean incluyentes y que actúen de manera equitativa dentro de distintas poblaciones. Ya que, como hemos mencionado, existen sistemas autónomos que discriminan a grupos de personas específicos.

Es importante recalcar que varias de las problemáticas derivadas del desarrollo de sistemas autónomos inteligentes están relacionadas con los datos recolectados de seres humanos, sin embargo no queda claro cuáles son las limitantes para que esta información se considere como parte de la investigación en seres humanos. Determinar qué datos pueden ser utilizados libremente, cuales requieren de un consentimiento informado, qué información debería ser considerada privada o sensible será parte de las tareas de las Comisiones de Ética en Inteligencia Artificial. En conclusión, debemos encontrar la forma de traducir los dilemas éticos asociados al desarrollo de IA al lenguaje propio del campo, para que se controlen las problemáticas con los datos y el diseño de dichos sistemas. Para ello debemos de re-interpretar los principios de la bioética en el contexto de la IA para salvaguardar los derechos humanos, ya que esta es la única forma de garantizar que dichos sistemas actúen para el beneficio de la sociedad.

Referencias:

[8] LeCun and Y. B. Hinton, “Deep learning.” .

[9] G. E. Moore, “Lithography and the future of Moore’s law,” 1995, p. 2.

[13] A. Vaswani et al., “Attention Is All You Need,” Jun. 2017.

[19] Covington, Paul, Jay Adams, and Emre Sargin. "Deep neural networks for youtube recommendations." In Proceedings of the 10th ACM conference on recommender systems, pp. 191-198. ACM, 2016.

[20] Covington, Paul, Jay Adams, and Emre Sargin. "Deep neural networks for youtube recommendations." In Proceedings of the 10th ACM conference on recommender systems, pp. 191-198. ACM, 2016.

[21] Latonero, Mark. "Governing Artificial Intelligence: Upholding Human Rights & Dignity". Data & Society, October, 2018.

[22] Zhao, Zhe, et al. "Recommending what video to watch next: A multitask ranking system." Proceedings of the 13th ACM Conference on Recommender Systems. ACM, 2019.

[23] Matamoros-Fernández, Ariadna. "Platformed racism: The mediation and circulation of an Australian race-based controversy on Twitter, Facebook and YouTube." Information, Communication & Society20.6 (2017): 930-946.

[24] Scott, Thomas W., et al. "The ecology of genetically modified mosquitoes." Science298.5591 (2002): 117-119.